摘要

当人们说话时,理解他们似乎是一种只用耳朵做的活动。那么,为什么我们通常要看我们正在听的人的脸呢?难道我们的眼睛也参与了理解言语吗?我们设计了一个实验,要求人们在不同的听力条件下尝试理解讲话,比如有人在嘈杂的背景噪音中讲话。事实证明,我们可以用眼睛来帮助理解言语,尤其是在难以听清的言语时。当一个人说话的时候看着他是有帮助的,因为他们的嘴巴和面部运动提供了关于所说内容的有用线索。在这篇文章中,我们将探讨视觉信息是如何影响我们理解言语的,并表明理解言语可以是耳朵和眼睛的共同工作!

说话者的面部动作能帮助我们倾听吗?

你有没有想过为什么人们经常看着他们正在听的人的脸?这种行为感觉很自然,而且在许多文化中,交谈时进行眼神交流是礼貌的表现。但是说话,就像所有其他声音一样,是由声波组成的,只有耳朵才能接收到。那么,我们在听的时候眼睛在做什么呢?事实证明,理解言语涉及眼睛和耳朵,尤其是在听力条件不理想的情况下,比如当背景音乐很吵的时候。在非理想的倾听条件下,听者可能会选择更仔细地看说话者的脸和嘴,以更好地理解所说的话。

之前关于耳朵和眼睛如何协同工作来帮助我们理解语言的研究主要集中在人们对简单语音的理解上,比如“ba”或“ga”。这些单词的短组成音被称为音素.当音素组合在一起时,它们可以创造出我们可能听到的所有单词。为什么以前的研究人员使用如此简单的声音?其中一个原因是音素没有任何意义,所以听者不能通过与声音一起说出的其他信息来对他们所听到的做出有根据的猜测,而是必须非常精确地听音素。一次测试一个音素是一种简单的方法,但当我们在日常生活中进行对话时,我们感知的不是单个的音素,而是完整、复杂的单词和句子。为此,我们小组进行了一项研究[1,我们要求参与者在不同的听力条件下试着理解说话者所说的句子。当然,观察某人的面部表情可以为我们提供说话人可能感受到的情绪信息,但面部运动也能帮助我们更好地听到说话人在说什么吗?我们的问题很简单:在语音理解过程中,为什么人们会看着说话人的脸?

眼睛在看哪里?

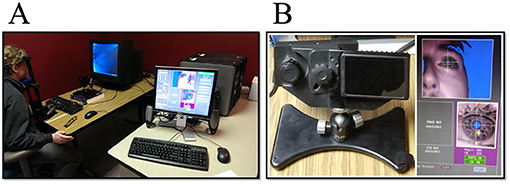

为了了解人们在聆听时如何以及为什么使用眼睛,我们需要一种监测眼球运动的方法。科学家如何追踪眼球运动?我们使用一种叫做眼球追踪器!我们在这项研究中使用的眼动仪有一个摄像头,可以知道听者在看哪里(图1).摄像头通过检测瞳孔中心(眼睛中部的黑色部分)来实现这一点,同时还使用传感器来跟踪光线如何被眼睛反射。这种光是由眼动仪相机旁边的非移动光源产生的。光反射信息用于计算眼睛是如何旋转的,从而计算出听者在屏幕上看的位置。

- 图一-(一)一名研究参与者坐在眼动仪前。

- 参与者坐着,脸靠在下巴上,而眼球追踪器(位于参与者和显示器之间)检测他们在看哪里。(B)眼睛跟踪硬件的特写,左边是摄像头,右边是红外照明器,以及监控参与者眼睛的计算机视图。

了解眼动仪收集的信息类型是很重要的。一种眼睛行为被称为固定这是指一个人在短时间内将目光集中在一个地方。例如,当别人给你拍照时,你可能会盯着镜头。另一种眼睛行为是扫视这是一种快速移动(两只眼睛朝着同一个方向)到一个新的位置,就像你快速地把眼睛从镜头上移开看其他东西一样。眼跳非常快——是人类最快的动作之一!当我们在日常生活中转动眼睛时,我们同时使用了注视和扫视。眼动仪可以识别并将眼球运动分类为注视或扫视,这对于研究人员更好地了解我们在完成任务时眼睛的活动非常重要。

我们如何研究眼睛在理解言语中的作用?

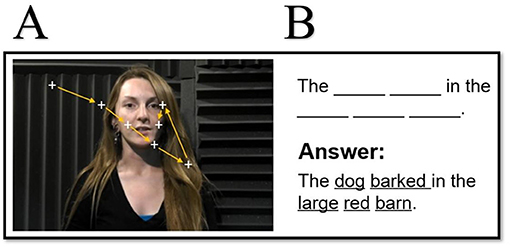

为了了解眼睛在倾听中的作用,我们设计了一项研究,让参与者完成一项简单的任务:他们听人们说话的音频片段或观看短电影片段,然后通过完成填空句(以下简称填空句)来报告他们听到的内容。图2).我们用眼动仪记录下人们在听的时候看的地方。对于一半的参与者,我们还通过在他们完成两项任务时播放巨大的静态噪音来模拟听力障碍。这使得我们的参与者中有一半人似乎有一定程度的听力损失,尽管他们在一般情况下听力没有问题。对于两组参与者,在每次重复任务时都播放不同程度的背景噪音。视频片段一开始很容易听到,讲话声音比背景噪音大得多。随着时间的推移,听力变得越来越难听,每隔六分钟,背景噪音就和演讲一样大!然后这个过程重新开始,又进行了另一组6个片段。

- 图二-(一)一个女人说一句话的电影片段样本。

- 在图的上方,我们可以看到由眼动仪记录的固定(十字)和扫视(箭头)的样本模式。(B)参与者在听到句子后回答的填空提示(上)和没有向参与者展示的正确答案(下)。

我们的研究结果表明了什么?

在没有播放视频的纯音频任务中,听力正常的参与者比模拟听力障碍的参与者更容易识别所说的话。这是有道理的,因为有听力障碍的人通常在理解言语方面有更多困难。然而,这只是告诉我们,当说话人的脸看不见时,人们能有多好地理解说话。当参与者也能看到说话者的脸时,这两组人的表现如何?

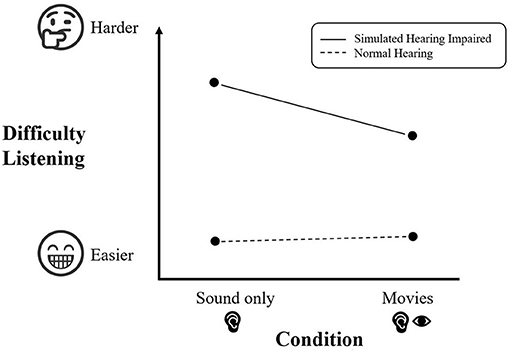

当我们观察实验的结果时,参与者一边听一边看演讲者的电影,并将这些结果与只有音频的实验结合起来,我们发现了一些有趣的现象(图3).我们发现,听力正常的参与者无论是否看到说话者的面部动作,都能以同样的准确性理解说话者所说的话。换句话说,他们在音频和电影条件下的任务表现相同。然而,当我们观察模拟听力障碍组时,一个有趣的发现出现了——当这组人可以看到说话者的脸时,他们在准确性测试中表现得更好!

- 图3 -我们的实验发现,听力正常的组(虚线)更容易理解句子,在只听音频的条件下和看电影的条件下都做得同样好。

- 模拟听力障碍组(实线)的情况更困难,但在电影条件下,当他们可以看到说话人的脸时,他们的表现要好得多!这告诉我们,眼睛可以帮助我们理解一个人在说什么。

我们还发现了参与者在看电影时用眼睛做的一些有趣的事情。我们发现,在模拟听力障碍条件下,参与者的总注视次数更少,这意味着他们将眼睛集中在屏幕上的位置比听力正常的组更少。我们还发现,随着背景噪音变大,参与者的注视时间变长。也就是说,当模拟听力障碍的参与者专注于某件事时,他们专注的时间比听力正常的人更长。这表明,在更困难的听力条件下,比如听力受损或有很多背景噪音时,人们倾向于更长时间地关注负责说话的面部区域。这意味着当听力有困难时,我们可以通过说话人的面部表情来更好地理解讲话。你可能也会这样做!例如,如果你在一个嘈杂的聚会上,你可能会发现自己会更仔细地观察你朋友的嘴和脸,以确保你明白他或她在说什么。

我们的研究结果意味着什么?

我们的实验表明,当听觉信息难以理解时,模拟听力障碍的参与者可以利用视觉信息。这一发现强调了我们的言语感知行为是多么灵活,以及我们如何通过眼睛来帮助我们理解言语。想象一下你认识的有听力障碍的人,比如爷爷奶奶。你有没有注意到,当你说话时,他们会比听力正常的人更频繁地看你的脸?这可能就是原因!你的祖父母可能正在用视觉来更好地了解你。

所以,让我们回到我们的研究问题,问自己:“为什么人们在听说话人说话时要看对方的脸?”在背景噪音的情况下,人们似乎会看说话人的脸,因为面部线索可以提供关于这个人在说什么的信息。我们的研究表明,我们的眼睛可以帮助我们理解所说的话,特别是当我们很难仅凭声音来理解所说的话时。此外,令人印象深刻的是,人们能够通过眼睛观察面部运动来适应理解言语。事实证明,我们的眼睛也参与了语言感知,而且我们的眼睛和耳朵可以一起完成这项任务——即使我们没有注意到它!这些发现不仅帮助我们更好地理解语言感知的基本过程,而且还可能帮助研究人员更好地设计技术来支持听力障碍患者。

术语表

音素:↑发音单位:口语中最小的发音单位当音素组合在一起时,它们就构成了任何给定语言中所有可能的单词。

眼动跟踪:↑一种计算机控制的装置,可以确定一个人在看哪里。眼球追踪器通常包含一个摄像头和一个光源,用于检测观看者的眼睛是如何旋转的。

固定:↑眼睛几乎完全静止的一段时间。注视是很短暂的,通常只持续不到一秒。

扫视:↑两眼在注视之间的快速运动,使眼睛快速“跳跃”(旋转)以聚焦世界的新部分。

利益冲突

作者声明,这项研究是在没有任何商业或财务关系的情况下进行的,这些关系可能被解释为潜在的利益冲突。

原文

↑Šabić, E., Henning, D., Myuz, H., Morrow, A., Hout, m.c., and MacDonald, J. 2020。在嘈杂的对话听力中,观察眼球运动的作用。前面。Psychol。11:200。doi: 10.3389 / fpsyg.2020.00200

参考文献

[1]↑Šabić, E., Henning, D., Myuz, H., Morrow, A., Hout, m.c., and MacDonald, J. 2020。在嘈杂的对话听力中,观察眼球运动的作用。前面。Psychol。11:200。doi: 10.3389 / fpsyg.2020.00200